En annonçant la prise en compte du genre grammatical pour une traduction, Google dit vouloir réduire les préjugés sexistes avec son outil dédié Google Traduction.

" Historiquement, Google Traduction n'a fourni qu'une seule traduction pour une requête, même si la traduction pouvait avoir une forme féminine ou masculine. Ainsi, lorsque le modèle produisait une traduction, il reproduisait par inadvertance des préjugés sexistes qui existaient déjà ", écrit Google en soulignant un modèle apprenant de centaines de millions d'exemples déjà traduits sur le Web.

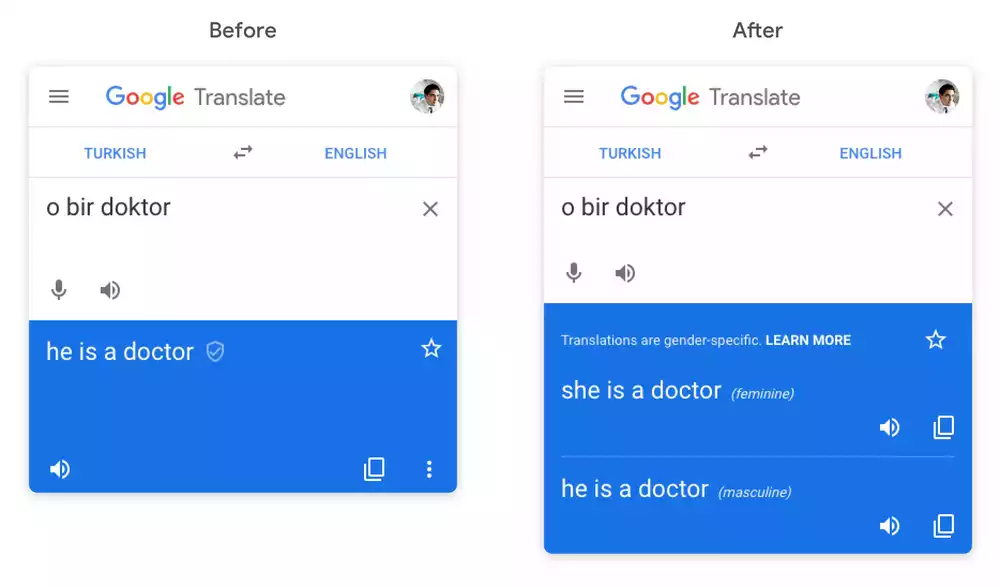

La parade est le choix entre le féminin et le masculin dans la traduction, avec par défaut deux propositions classées en fonction de l'ordre alphabétique de leur libellé (féminin et masculin). Un changement en cours de déploiement qui sera ultérieurement proposé avec les applications mobiles.

Pour le moment, cela concerne la traduction de l'anglais vers le français, l'italien, le portugais ou l'espagnol pour des mots, ainsi que la traduction de phrases et expressions du turc vers l'anglais. Google donne les exemples des mots " strong " ou " doctor " avec un biais masculin, et " nurse " ou " beautiful " avec un biais féminin.

Cette prise en compte du genre grammatical sera étendue à d'autres langues et pour des fonctionnalités comme la saisie semi-automatique. Google évoque également un travail sur la prise en compte du genre non-binaire.

Dans ses principes pour des pratiques responsables en intelligence artificielle, Google affiche pour ambition d'éviter de créer ou renforcer des préjugés injustes. Le sexisme en fait notamment partie. C'est intimement lié à la sélectin du jeu de données pour entraîner les algorithmes de machine learning.